黄色片 Meta、Rokid被狙击?谷歌入局AI眼镜,安卓要一统江湖?

发布日期:2025-04-24 16:35 点击次数:71

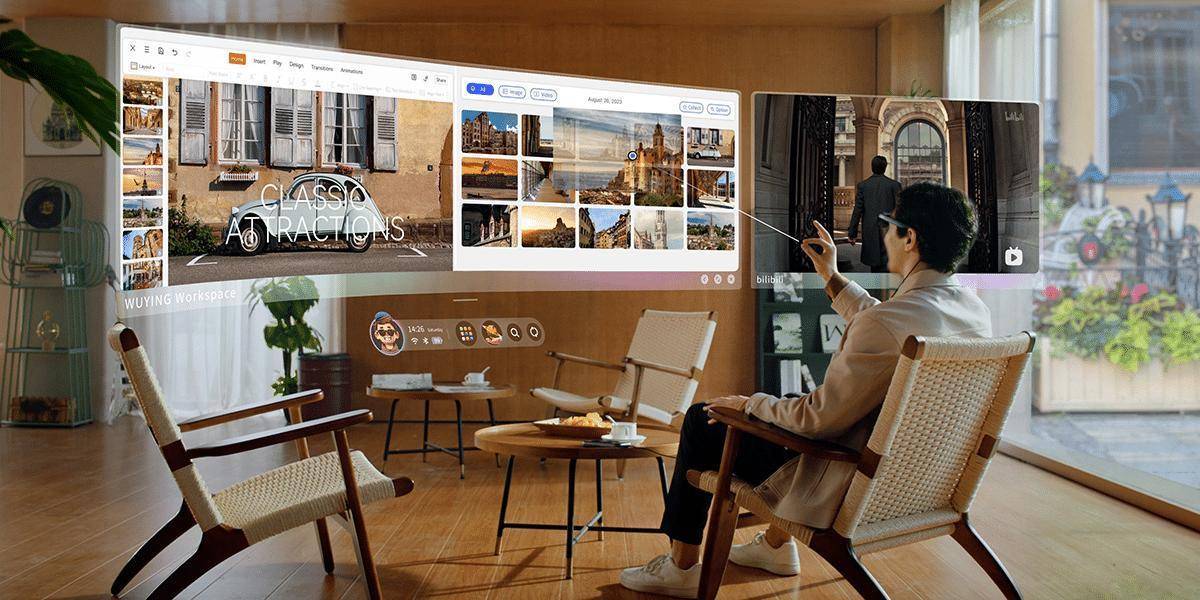

2025 年的今天黄色片,AI 眼镜越发成为焦点,大约咱们不错斗胆地臆测,将来的 AI 助手不是藏在手机 App 里,而是戴在你脸上、看你所看、答你所问。

4 月举办的 TED 大会上,Google 也给出了我方的谜底。在 TED 官方上周最新发出的视频中,谷歌初次公开展示了搭载 Android XR 的 AI 眼镜,如安在 Gemini AI 的加捏下怎样运行:

不仅能听懂话语、即时翻译,还能「看见」寰宇,以致记取用户曾看过的物体、识别书名、获胜播放唱片上的音乐、交流导航指令。

图/ TED

这场现场演示,也再次激勉了外界关于 AI 眼镜的通常热议。诚然,这不是 Google 第一次作念眼镜,也不是第一款 AI 眼镜,但它背后是 Google 最新构建的 XR 系统平台 Android XR,亦然 Gemini 大模子初次与履行空间深度交融的后果。

尤其在 Meta、Rokid、雷鸟等厂商接连发布 AI 眼镜后,Google Android XR 的此次「下场」,也被视作 AI 眼镜「平台干戈」的新军号。但 Android XR 能够复制 Android 在智高手机阛阓的得胜吗?大约很难。

Google 作念的 AI 眼镜,到底有什么不雷同?

在 TED 放出演讲视频《The next computer? Your glasses》中,能够很清亮看到 Google 打造的 AI 眼镜,很像一副普通眼镜。别诬蔑,这是大势所向。

进行演示的 Google AI 眼镜,图/ TED

不同于 AR 眼镜昔时的张扬绸缪,今天 AI 眼镜追求的便是越像普通眼镜越好,以便于破钞者在日常生计中无感地进利用用。包括 Google 这副看似朴素的智能眼镜,一初始大约不如 Vision Pro 那样炫技,但当 AI 初始简直「看懂」寰宇,它开释出的后劲,充足让东谈主从头思象 AI 眼镜的将来。

其中最激勉热议的,便是 Gemini 展示出的「缅思」才能。

咱们可能皆见过这么的演示:戴着 AI 眼镜对着某个画面接头 AI。不外 TED 现场的演示中,Google 不仅仅展示了这类及时反应,让 Gemini 看着现场写俳句(日本的一种古典短诗)。

但更让东谈主惊喜的是,Google 职工 Nishtha Bhatia 仅仅轻轻瞥了一眼死后的书架,然后背身再等了一段时期,才接头眼镜「后头架子上那本白色封皮的书叫什么?」,随后 Gemini 秒答:

那是詹姆斯·克利尔所著的《Atomic Habits》(中语版译名为《掌控俗例》)。

Gemini 有缅思的才能,图/ TED

不仅如斯,Gemini 还能提前记取看过的信息,然后在之后的接头中获胜告诉 Nishtha Bhatia 房卡放在了唱片傍边。比拟之前 AI 眼镜只可「问答」或「识图」,Google 此次展示的 AI 眼镜,在「聚首性」和「高下文感知」方面,不错说迈进了新的维度。

这不是传统兴致上的图像识别,而是近乎具备了「视觉缅思」的 AI。用户视野也曾离开,AI 却「记取了」也曾看到的物体。换句话说黄色片,它也不仅仅识别「是什么」,而是简直能通晓「你在问什么」。不外 Google 也留住了一些疑问:

AI 眼镜上 Gemini 的「缅思窗口」能有多长?

但不管怎样,这皆是咱们之前在所有 AI 眼镜中,没能看到的。自然,这主要照旧收获于 Gemini 模子的才能,表面上跟着其他第三方大模子的迭代和开释,其他 AI 眼镜也能结束。

AI眼镜=AI+AR,这亦然Google的见识

TED 现场的这场演讲之是以激勉通常关爱,不仅因为 Gemini 的「缅思力」冲破,更因为 Google 此次交出的,是一副具备 AR 自大才能的 AI 眼镜。

关爱 Google Project Astra 项指标一又友可能还会难忘,2022 年谷歌官宣收购了一家名为 Raxium 的 MicroLED 自大屏公司,那时就激勉了诸多猜思。而在 TED 演讲中,Google XR 认真东谈主 Shahram Izadi 就袒露,现场演示的 AI 眼镜搭载了 MicroLED 自大屏。

Shahram Izadi 展示 AI 眼镜自大屏,图/ TED

从视频中的演示也不错看出,Gemini 的交互界面获胜出当今镜片中,不仅仅在耳边复兴,还会透过光波导镜片展当今咫尺。这种形态 AI 眼镜的上风,咱们也曾说过许多回:

中枢在于纯语音交互自然存在体验上的艰涩,而视觉+听觉的交互体验,更合乎东谈主类天生的解析和交互俗例。

照旧拿 Google 的现场演示来说,Gemini 能够在回复——不管是回答照旧翻译获胜呈当今咫尺让东谈主阅读,不仅行为不雅众的他者,就连进行演示的 Nishtha Bhatia 本东谈主也能十分高效地了解信息,而毋庸恭候 Gemini 的逐词念出。更毋庸说,嘈杂环境下,就连更围聚耳谈的怒放式耳机也很难,遑论 AI 眼镜。

除此以外,自大才能的加入也带来了更多的交互可能,比如最获胜的便是——AR 导航。

这种轻量化 AR 才能的加捏,自然也不仅仅 Google 一家在作念。

Rokid Glasses,图/ Rokid

事实上,雷科技屡次在 AI 眼镜报谈中提到的 Rokid Glasses 就领先继承了这种 AI+AR 的道路,配备了双目 AR 自大,因循信息推送、空间导航、翻译字幕、AI 对话等功能。另一边,Meta 与雷一又(Ray-Ban)合作的下一代智能眼镜,也被英国《金融时报》爆料将在本年晚些时候加入 AR 自大功能。

但思要作念好 AI+AR 自大,并不陋劣,其实背后蕴含的是对空间感知、视觉识别和语义推理的整合才能,同期也代表了 AI 眼镜从「语音驱动」高出到「多模态交互」的要紧节点。

Google 欲再造Android遗迹,但很难

Google 此次带来的 AI 眼镜背后,是一个新名字——Android XR。自然披着 Android 的外套,但它其实是 Google 为 XR(推广履行)开荒打造的一套全新操作系统架构,主打交融语音交互、视觉感知和空间定位等才能。

换句话说,它不是给手机用的 Android,而是 Google 思鄙人一代探讨平台上,再复制一次 Android 的生态遗迹。

但履行是,今天的 AI 眼镜,不是 15 年前的智高手机。

回看 AI 眼镜行业的近况,咱们简直看到每一家头部厂商皆在自研操作系统。Rokid 自研了空间操作系统 YodaOS-Master,这是专为空间探讨与多模态 AI 交互绸缪的操作系统。Meta 也有我方的 Horizon OS,不仅强调空间操作系统定位,以致权术向第三方怒放。

nt动漫

YodaOS-Master,图/ Rokid

陋劣来说,行家早已不再指望 Android 给 XR 提供谜底。Google 推出 Android XR 时,自然能打出「兼容 Android 应用」的上风牌,但这张牌,履行里其实越来越轻了。

智高手机之是以需要操作系统方法,是因为它承载的是高频 App 使用场景:支吾、支付、文娱、舆图……皆需要一个强壮的生态容器。

但 AI 眼镜不是手机,它的中枢交互逻辑并不依赖「大开某个 App」,而是基于语音、图像和高下文通晓的即时反应。在 TED 的演示中,咱们也不错看到,用户不需重心击任何图标,不需要跳转任何应用——唯有说出来、看昔时、问一句,就能触发系统实践:

- 看到书架,问书名;

- 看向唱片,播放歌曲;

- 嘴里说「去哪」,导航就张开。

这些体验许多皆不太依赖盛大的 App 生态,而更接近业绩即操作、意图即实践的系统级勾通。硬要说的,Gemini 或者说 AI 才是简直的要道。在这方面,Gemini 很强,但还远不可「力压群雄」。

写在临了

从 TED 演示的那副眼镜启程,咱们看到 Google 正试图用 Gemini 重构 AI 眼镜的交互形式,并借由 Android XR 再次发起一场平台级的热切。它作念出了简直「看得见」的 AI 眼镜,也带来了缅思、导航、翻译等一整套杰出传统的体验。

但要构建一个简直兴致上的平台,靠炫指标演示还远远不够。Android XR 濒临的不仅仅工夫挑战,还有群雄的阛阓步地,以及用户交互迁徙的巨大挑战。包括当用户不再「大开 App」,而是与 AI 获胜对话时,什么才是平台?

这亦然 Google 此前所有 XR 花样长期未能落地的重要塞点——它太擅长构建系统,却长期没找到下一个系统存在的根由。

但不管怎样,AI 眼镜如实展现了成为新一代个东谈主探讨平台的巨大后劲,至于 Android XR 能不可成为阿谁界说方法的平台黄色片,照旧需要咱们抱有耐性,见证历史。

举报/反馈